3月7日消息,AMD公司今天发布公告,表示用户可以本地化运行基于GPT的大语言模型(LLM),从而构建专属的AI聊天机器人。

AMD表示用户可以在包括采用AMD新XDNANPU的Ryzen7000和Ryzen8000系列APU,以及内置AI加速核心的RadeonRX7000系列GPU设备上,本地运行LLM和AI聊天机器人。

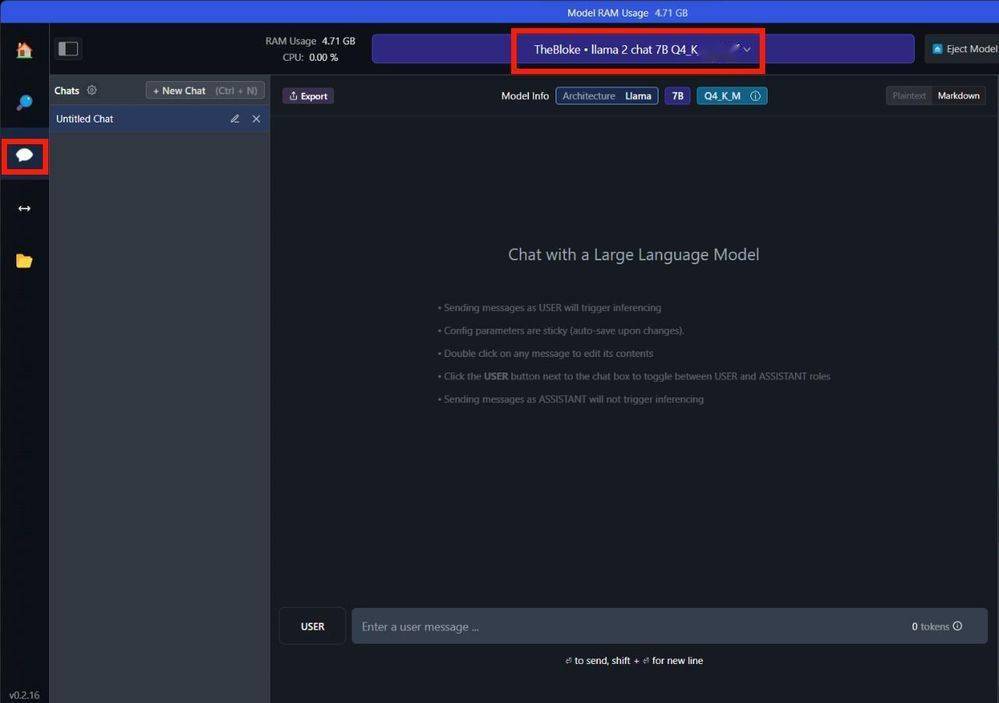

AMD在公告中详细介绍了运行步骤,例如运行70亿参数的Mistral,搜索并下载“TheBloke/ OpenHermes-2.5-Mistral-7B-GGUF”;如果运行70亿参数的LLAMAv2,搜索并下载“TheBloke/Llama-2-7B-Chat-GGUF”。

AMD并不是第一个这样做的公司,英伟达(NVIDIA)最近也推出了"ChatwithRTX",这是一个由GeForceRTX40和RTX30系列GPU支持的人工智能聊天机器人。它采用TensorRT-LLM功能集进行加速,基于本地化数据集提供快速生成的人工智能结果。

微信扫一扫打赏

微信扫一扫打赏

支付宝扫一扫打赏

支付宝扫一扫打赏

发表评论

评论列表(0)